RNN/LSTM/GRU/GCN

最近对强化学习算法和预测结合有些想法,阅读了下面两篇文章对之有了大致认识。

参考:https://zhuanlan.zhihu.com/p/587276701

参考:https://zhuanlan.zhihu.com/p/605750441

循环神经网络RNN

传统的神经网络只能单独的取处理一个个的输入,前一个输入和后一个输入是完全没有关系的。但是,某些任务需要能够更好的处理序列的信息,即前面的输入和后面的输入是有关系的。

由此诞生了RNN。

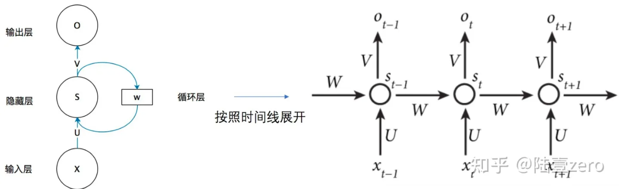

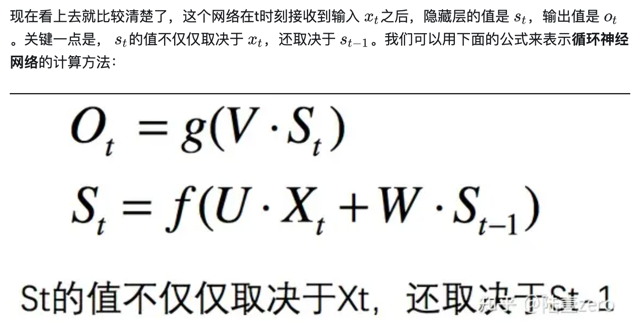

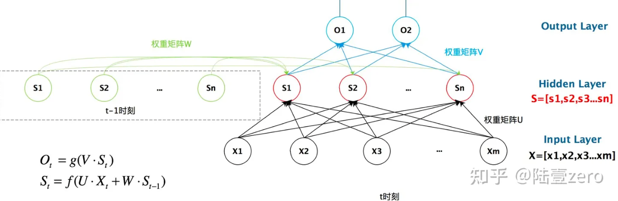

循环神经网络(Recurrent Neural Network, RNN)是一类以序列(sequence)数据为输入,在序列的演进方向进行递归(recursion)且所有节点(循环单元)按链式连接的递归神经网络。

1 | x 输入层 向量 |

循环神经网络的隐藏层的值s不仅取决于当前这次的输入x,还取决于上一次隐藏层的值s。

具体的抽象图:

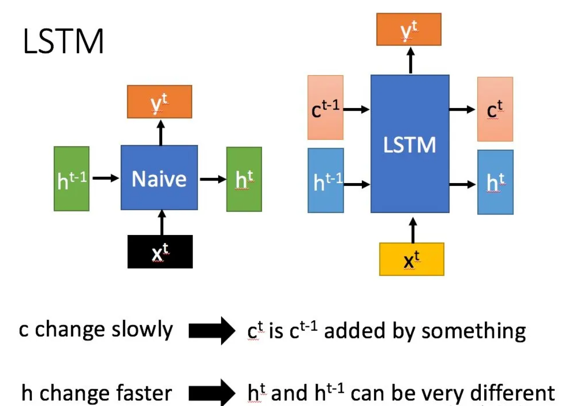

长短期记忆网络LSTM

长短期记忆(Long short-term memory, LSTM)是一种特殊的RNN,主要是为了解决长序列训练过程中的梯度消失和梯度爆炸问题。简单来说,就是相比普通的RNN,LSTM能够在更长的序列中有更好的表现。

(左:RNN,右:LSTM)

All articles on this blog are licensed under CC BY-NC-SA 4.0 unless otherwise stated.

Comments

ValineDisqus